人を補助するAI

心強い発展も見られるが、現在のAIシステムに重要な判断を任せられないというのであれば、どうすればよいのだろうか?

Lenke氏はいくつかの選択肢を提示している。同氏は「より具体的なケースでまず必要となるのは確からしさを判断するための基準だ。このため、ニューラルネットワークからは結果だけではなく、それがどの程度正しい結果なのかという確信度を得ることになる。これにより、追加のエビデンスが必要かどうかや、結果を人間がチェックする必要があるのかどうか、額面通りに結果を受け取ってよいのかどうかといった意思決定が可能になるのだ」と述べている。

Lenke氏は「その後、手元のタスクに目を向ける必要がある」と続けたうえで、「何が起こったのかを完全に理解できていない場合、さらには(ニューラル)ネットワークが誤った結果を導き出した場合であっても、致命的な問題とならないケースがある。例えば、ユーザー好みの楽曲を見つけ出してくれるシステムが誤った結果を導き出したとしても、退屈な音楽を聴かされるのが関の山だ。しかし、金銭処理が絡む顧客サービスアプリケーションや、コンピュータの支援によって臨床記録の改善を目指すアプリケーションの場合、AIを孤立させたかたちで使用するのではなく、人間との共同作業というかたちで使用するのが一般的だ」と述べている。

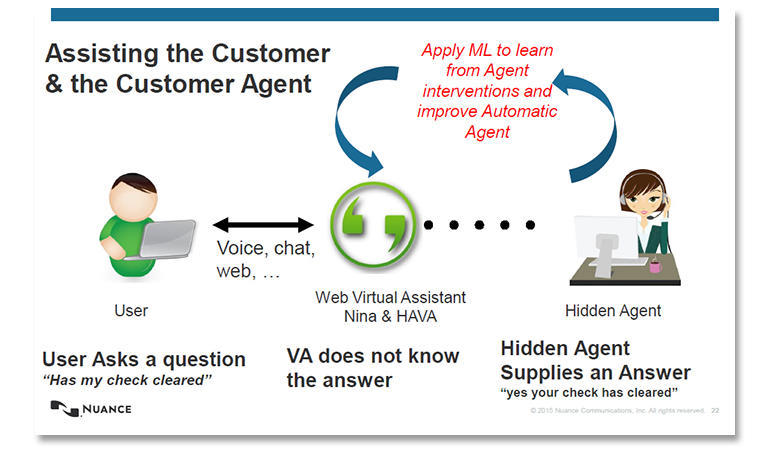

人が支援する仮想アシスタント(HAVA)は、企業の顧客サービスアプリケーションで利用されている。

提供:Nuance Communications

Lenke氏は「カスタマーケアの分野において、われわれはこれをHAVA(Human-Assisted Virtual Assistant)、すなわち人が支援する仮想アシスタントと呼んでいる」と述べるとともに、「ここでの興味深い技術は『パッセージ検索』と呼ばれているものだ。例えば顧客が質問してきた場合、それが音声認識によるものか、チャットやウェブインターフェース経由でタイプ入力されたものかにかかわらず、仮想アシスタントは企業が用意したマニュアルやドキュメント一式などに記されている事実やデータのなかから、質問内容と強く関連のある意味的なまとまり(パッセージ)を探し出し、人間のエージェントに提示する。そして、その人間が最終的な判断を下す。AIが適切な情報を人間に提示するため、より効率の高い運用が可能となる」と説明している。

Lenke氏は「人間の監督なしにAIを使う場合に生み出されるリスクは、Microsoftのチャットボットの一件を見れば分かるはずだ」と付け加えたうえで、「重要なアプリケーションでは、人間が内容に目を通し、最終的な判断を下すという評価プロセスが適切となる。われわれがそう確信している理由がここにある」と述べている。

後編に続く。

この記事は海外CBS Interactive発の記事を朝日インタラクティブが日本向けに編集したものです。