立教大学

報道関係各位

立教大学大学院人工知能科学研究科(所在地:東京都豊島区、研究科委員長:内山 泰伸)の石川 真之介 特任准教授、瀧 雅人 准教授、内山 泰伸 教授と株式会社 豆蔵(本社:東京都新宿区、代表取締役社長:中原 徹也)による研究チームは、AIの判断を「AIモデルが具体的にどのようなデータを学習したか」で説明する「説明可能AI」の手法を開発しました。この手法により、「AIの判断結果が信頼できるか」について簡単に、直感的に判断することができるようになります。本研究成果は国際学術論文誌「International Journal of Applied Earth Observation and Geoinformation」に掲載されました。

研究背景

説明可能AIへの期待

近年のAI技術の発展により、社会の様々な課題に対してAIの活用が検討されていますが、AIの判断結果を本当に信じてよいかわからない、そのためAI導入に踏み込めないという課題が提起されています。この課題の解決に役立つと期待されているのが、説明可能AI (Explainable AI, XAI)という研究分野です。説明可能AIはAIの判断に対する説明や解釈を行うもので、AIの判断の位置づけを理解するために役立てることができます。総務省 情報通信政策研究所の「 (リンク ») (リンク ») ガイドライン」 (リンク ») でもAIサービス提供者は透明性の原則としてAIの判断結果の説明可能性に留意すべきであると記載されています。

説明可能AIの代表的な手法には、AIの判断に対して影響力が大きかったと考えられる要素を抽出するというものがあります。例えば、「あなたは病気のリスクが高い」というAIの予測に対し、「血圧が高いことが大きく影響している」ということを説明として示すという手法です。このような手法は直感的にわかりやすいですが、一方でわかりやすさのため、非現実的な仮定をおく、もしくはより単純な手法への近似を行うといった方法がとられており、高度なAIモデルの豊かな表現力が損なわれていると捉えることもできます。本研究では、AIの判断を説明するのにこれらの手法とは別のアプローチをとることとしました。

「データ中心」の観点

AIが精度良く判断を行うことができるかどうかは、AIモデルの構成や学習アルゴリズムとともに、どのようなデータでモデルを学習させたかに大きく影響を受けます。近年、社会での活用におけるAIの精度向上には、複雑なモデルを利用することよりも学習データの量や質を向上させることの方が重要である場合が多く、AIの活用においては「データ中心」に考えるべきだという指摘があります。これまでの説明可能AIの手法は多くが「入力データからどのように予測が導かれるのか」というAIモデルのプロセスを対象としたもので、学習データに注目したものはほとんどありませんでした。

AIに限らず、ある判断が信頼できるかどうかを我々は普段どのように決めているでしょうか。例えば、人が「ある対象が猫である」という判断をしたとします。この判断が信頼できるかどうかを確認するため、人がどのように対象を猫と判断するかのプロセス、つまりは「猫に反射した光が目に入る」「電気信号が脳細胞を刺激する」といった説明を求めるでしょうか。実際にはそのようなプロセスではなく、「過去にどのような動物を見たことがあるか」と具体例を説明する方が説得力があるように感じられます。猫を見たことがない人の判断はあまり信頼できないでしょう。似た種類の猫を飼っている人であれば、その判断は信頼できるように感じられます。これが「過去にどのようなデータを学習したか」、すなわちデータ中心の観点にあたります。

研究結果

「何から学んだか」を示す手法 WIK

本研究では「データ中心」の立場に立ち、「実際にAIモデルがどのようなデータで学習したのか」を具体例で示すことでモデルの判断を説明する説明可能AIの手法を開発しました。我々の手法では、特にAIの個別の判断を説明するために、これまで学習したデータの中で今回対象となっているデータに一番近いもの、すなわちAIが一番近いと判断したものを提示します。我々はこの手法を、AIが「私の知っていること」を提示するという意味で What I Know (WIK) と名付けました。

本手法と近いアプローチの手法はすでにいくつか提案されていますが、本手法は提示する例に「最終的にAIがどのような判断をしたか」を考慮している点が他の手法にはない点です。「対象が猫である」という判断が信頼できるかどうかを確認するために知りたいことは、通常「これまで見たことのある『猫』の中で一番似ているものは何か」であり、「これまで見たことのある『もの一般』の中で一番似ているものは何か」ではないと思われます。「これは猫だが、これまで見た食パンとよく似ている」と言われても結果の信頼性を評価する参考にはならず、困惑するばかりです。このことから、我々の手法では例示する学習データは対象となる判断と同じ判断結果となったものに限られるように制約を加えました。

衛星画像の分類による有効性の確認

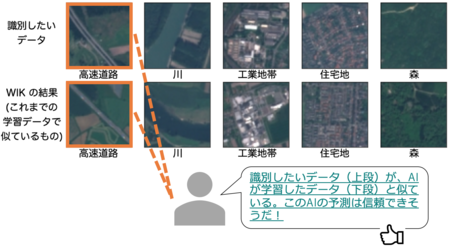

今回発表した論文では、この手法を人工衛星による地球観測画像の分類問題に適用し、その有効性を示しました。用意した深層学習によるAIモデルでは衛星画像に何が写っているかを、森、住宅地、川、高速道路など10 種類に分類します。識別する対象として5つの衛星画像を用意し、WIKによりそれぞれの類似画像を提示した例が以下の図です。この図の上の段は今回識別対象とするデータであり、下の段は、モデルが学習したデータの中で最も上の段の画像に近いと判断されたものです。下段の画像は上段の画像に近いことから、このAIは上段の画像を識別するのに十分な学習を行なっていると言えます (先ほどの例では「十分な経験を持っている」ことに対応します)。このことから、このAIの判断結果は信頼できそうだということが確認できます。

【画像: (リンク ») 】

衛星データを用いた提案手法の有効性確認結果と活用イメージ

今後の展望

本研究はすぐに多くの課題に適用可能であると考えられるため、人工知能科学研究科での社会の実課題を対象とする研究活動の中でその有効性を検証していきたいと考えています。特に、2023年度に新設される予定の研究科附属の産官学連携センターである「応用人工知能イノベーションセンター」では社会課題の解決への貢献を目的の一つとしており、そのために本手法を活用していきたいと考えています。

論文情報

S. Ishikawa, M. Todo, M. Taki, Y. Uchiyama, K. Matsunaga, P. Lin, T. Ogihara and M. Yasui, "Example-based explainable AI and its application for remote sensing image classification," International Journal of Applied Earth Observation and Geoinformation, Vol. 118, p. 103215, 2023.

掲載先: (リンク »)

arXiv: (リンク »)

お問い合わせにつきましては発表元企業までお願いいたします。