言語理解AIとは?

人工知能(AI)は、人間の知的能力をコンピューターで再現したものの総称です。従来は人間が作成したルールや、データを分析することで得られた統計情報をもとにAIを作成していました。しかし、近年ではデータ中の特徴やパターンを発見する機械学習、特に、そのなかでも人間の脳神経細胞にヒントを得た手法である深層学習(ディープラーニング)によるAIがその驚異的な精度で脚光を浴びています。

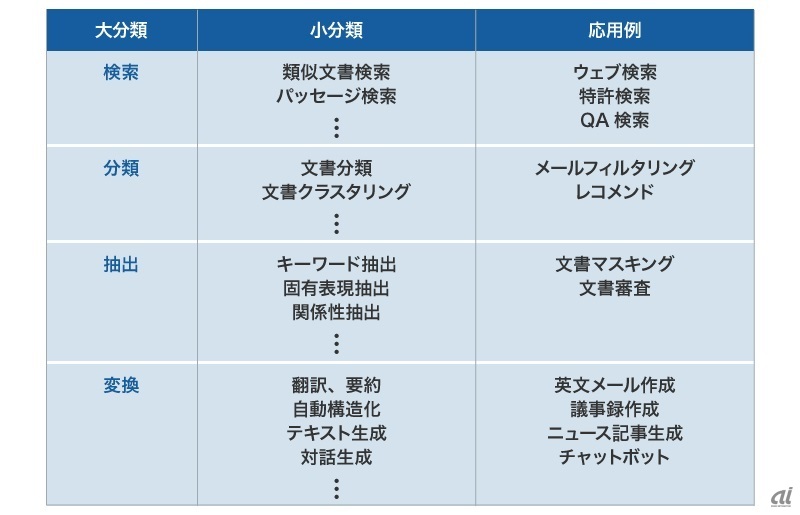

それでは、言語理解AIとは、何なのでしょうか? 言語理解AIは、画像認識や音声認識、文字認識などと並んだAIの一種で、人間が文章を読んで内容を理解する能力をコンピューターで実現したものです。言語理解AIができることは具体的に大きく、「検索、分類、抽出、変換」の4つに分けられます。

検索では、ウェブ検索サービスにおける自然文検索や、人間からチャットボットへの質問の回答提示などに応用されています。分類では、スパム広告や迷惑メールの自動フィルタリング、音楽、商品などのレコメンドといった応用例があります。

抽出では、文書中の開示したくない個人情報などを黒塗りする自動マスキングや文書中から法的リスクのある記述を自動的に見つけ出す契約書のリスクチェックなど、変換では、ウェブコンテンツの機械翻訳サービス、ニュースや論文などの自動要約サービスといった応用例があります。

表1:言語理解AIの分類と応用例(出典:NTTデータ先端技術)

表1:言語理解AIの分類と応用例(出典:NTTデータ先端技術)

※クリックすると拡大画像が見られます

トランスフォーマーの登場

画像認識AIはディープラーニングで2015年に人間の能力を超えた一方、最近まで言語理解AIは人間の能力に追いつくことすら難しい状況でした。

どうして画像に比べて言語の理解は難しいのでしょうか。それは、文の表す意味を正しく理解するためには文の構造(文法)を捉え、前後の文脈を理解し、省略された情報を推定するといった高度な知的能力が必要になるためです。

国立情報学研究所が中心となったプロジェクト「ロボットは東大に入れるか」では、東大に合格する能力をもったAIの実現を目標にしていましたが、2016年に取り組みを中断しました。これは、人間並みの言語理解が可能なAIが実現困難であるということが大きな要因となっています。しかしながら、2017年に登場した「トランスフォーマー」とよばれる新しいディープラーニング手法により飛躍的にAIの言語理解能力が進歩し、一部のタスクでは人間の能力を超える驚くべき結果を出しました。

トランスフォーマーによる言語理解AI、BERTとGPTシリーズ

トランスフォーマーは、2019年にGoogleが発表したディープラーニング手法です。この手法は、「長い文脈を覚えておくことができる」「文脈の中でも重要な部分に注目することができる」「学習アルゴリズムが超大規模なデータの学習に向いている」といった特徴から、優れた高精度な言語理解を実現します。

このトランスフォーマーに基づいて次々と高精度な言語理解AIが発表されました。そのなかでも、Googleが発表した「BERT」とOpenAIが発表した「GPT」シリーズ(GPT-1、GPT-2、GPT-3)はその驚異的な精度以外にも、「目的ごとに一からAIを作成する必要がある」「AIの作成に大量の学習データが必要」という従来の言語理解AIの持っていた問題を解決したとして注目を集めています。