Clouderaは8月2日、プライベートイベント「Evolve 2023 Tokyo」を開催。同イベントに登壇するため来日したプロダクトマネジメント担当副社長のPriyank Patel氏に人工知能/機械学習(AI/ML)の最新動向について聞いた。

「ChatGPT」をはじめとする生成AIの利便性や可能性への注目が急速に高まっている。Patel氏は、ChatGPTの先を見据えた企業のAI戦略として、「信頼のできるAIを大規模に展開するには、まずデータに目を向けることが重要」だと語る。特に、企業が保有する「自社のコンテキスト(文脈)に照らし合わせたデータ」に着目すべきだといい、企業が持つ独自のデータが「AI戦略に『違い』をもたらす」と強調した。

同氏はエンタープライズにおけるAI活用のこれまでを振り返った。従来のMLモデルでは、主にデータサイエンティストが中心となって特定のデータセットに対して学習を繰り返しながら専用モデルを構築していく過程を踏んでいた。それが大規模言語モデル(LLM)では、汎用モデルを利用するため追加のデータや学習なしに多くの開発者が活用できるという。

Cloudera プロダクトマネジメント担当副社長のPriyank Patel氏

LLMの企業利用に必要なこととして、Patel氏は「文脈の認識」「強力なプライバシー」「ホワイトボックス」の3つを挙げる。特に文脈の認識については、「企業が有するナレッジベースの活用が重要」(同氏)だと話す。Couderaでは、機械学習プラットフォーム「Cloudera Machine Learning」上の「Applied Machine Learning Prototypes」(AMP)で、企業が保有する独自のデータで拡張されたLLMチャットボットをユースケースとして提供している。

Patel氏は、オープンソースとして提供されているLLMにも目を向ける。「Stanford Alpaca」や「StarCoder」「BLOOM」「Llama 2」「Falcon 40B」など、オープンコミュニティーで開発されたLLMが数多くリリースされており、OpenAIのChatGPTやGoogleの「Bard」といったクローズドなLLMと比べても急速な進化を遂げている。「AIにおけるオープンソースの力が大きくなっている」と同氏は指摘した。

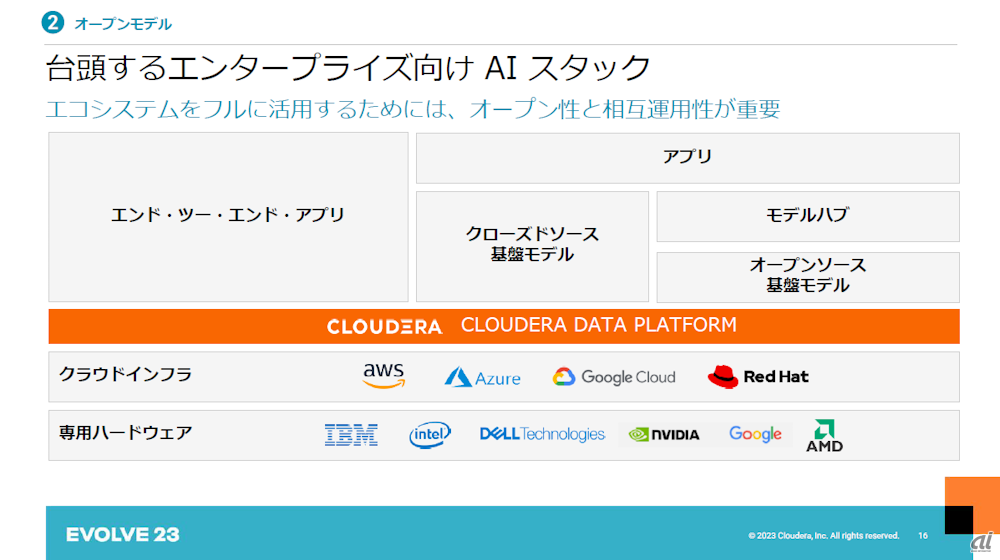

また、エンタープライズ向けのAIスタックが拡大する中、そのエコシステムをフルに活用するには、データプラットフォームのオープン性と相互運用性が重要になるとの見解を示した。

AIスタックと「Cloudera Data Platform」の位置づけ

シンガポールに拠点を置く大手銀行のOversea-Chinese Banking Corporation(OCBC)は、LLMを用いてソースコードを自動補完するツール「OCBC Wingman」を開発。StarCoderを活用しており、約2000人の開発者が使用しているという。オンプレミスで運用するため、外部環境にコードが流出する恐れがなく、学習データとして収集されることもないとのこと。OCBCが標準として定めるコード基準やコード例、ライブラリーなど、同社の文脈を理解したコーディング支援を可能にしている。

もう一つは、コールセンター向けの自動音声認識でのLLM活用になる。これは、顧客とオペレーターの会話を音声からテキストに変換する機能で、テキスト化された会話をAIが自動で要約することもできる。「コンタクトセンターのプロセスを簡素化し、顧客による苦情を特定することに役立っている」(Patel氏)

OCBCの事例のように生成AIを本番環境に組み込み、幅広い影響力を示している中、企業が確かなAI戦略の構築していくためには「変化していないことに焦点を当てること」が重要だとPatel氏は話す。具体的には、「セキュリティ、ガバナンス、暗号化」「エンタープライズ対応」「オープンコミュニティー」「コスト管理」「データプラットフォーム」を挙げ、「データプラットフォームは企業のAIプラットフォームであり、LLMなどのさまざまなテクノロジーの進化などがあったとしても変わらない」と強調した。