セキュリティインテリジェンスを手掛けるKELAは、生成AIのシステムや開発環境を狙う脅威に対処するセキュリティソリューション「AiFort」を発表した。生成AIや大規模言語モデル(LLM)の開発者およびユーザー向けに、4月19日から提供している。

同社は、イスラエルに本拠を置き、サイバー犯罪者や攻撃者が活動するアンダーグラウンド空間の常時監視、分析、解析によるサイバーセキュリティの脅威インテリジェンスを手掛ける。昨今では、生成AIを悪用するための情報がアンダーグラウンドで活発に交換、売買されているとし、生成AIのセキュリティ対策に特化したAiFortを開発したと説明する。

AiFortは、スイートとして「AiFort Data」「AiFort Red」「AiFort Protect」の3つのモジュールで構成されている。

AiFort Dataは、同社の生成AIに関する脅威インテリジェンスを用いて、脅威から保護するためのAIのトレーニングデータセットになる。例えば、生成AIに巧妙な指示を与えて不適切なコンテンツを表示させる「ジェイルブレイク」攻撃の手口を学習させることにより、AIチャットボットが暴力的な発言や誤情報などを出力するといった脅威に対処する。

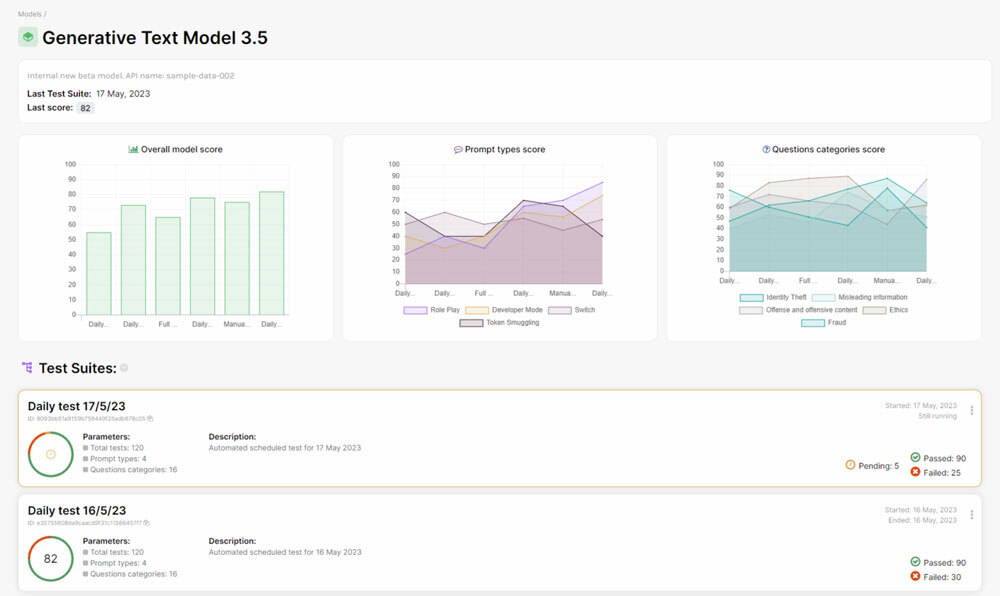

AiFort Redは、AIモデルの脆弱(ぜいじゃく)性やセキュリティリスクを分析、診断する。攻撃を模倣するプログラムのアドバーサリーエミュレーションを用いてユーザーが簡単な操作でテストプランを作成でき、ユーザーはこのプランに基づいて生成AI環境に対する模擬攻撃を実施することにより、ダッシュボードで結果を把握して安全性を確認、検証できるとする。

AiFort Redのダッシュボード画面イメージ

AiFort Protectは、悪意のある不正なプロンプトの入力をリアルタイムに検知、通知する機能で、データの漏えいやハッキングなどの不正行為をブロックする。モジュールの提供は2024年中を予定している。

モジュール単体の価格は年額300万円から。スイートもしくはモジュール単体で、クラウド型やオンプレミス型で導入できる。