超巨大言語理解AI --GPT-3

次に、もう一つのトランスフォーマーによる言語理解AI、GPTシリーズ(GPT-1、GPT-2、GPT-3)を紹介します。GPTシリーズはElon Musk氏が出資者の一人である非営利団体OpenAIが開発したもので、初代のGPT-1はBERTと同じ2018年に発表されました。

その後、2019年にGPT-2、2020年にGPT-3が発表されましたが、基本的には中身は同じで、トランスフォーマーの規模と学習データの量をどんどん大きくしていったものだと言えます。

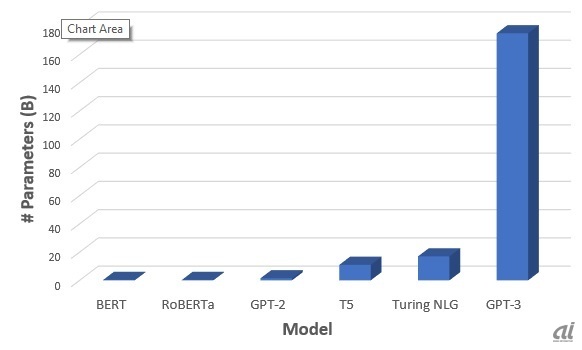

図4は各専門のデータサイエンティストのさまざまな見解を集めたブログ「Towards Data Science」に掲載されたものですが、GPT-3がいかに巨大なものであるかが一目でわかります。

図4:言語理解AIのトランスフォーマーの規模(パラメーター数)の比較

(出典:Towards Data Science)

※クリックすると拡大画像が見られます

その結果として、GPTシリーズは人間並みの作文能力をもつようになりました。GPT-2は、フェイクニュースの作成に利用される恐れがあるためにモデルの公開が一時中止されたほどの作文能力で話題になりましたが、GPT-3はさらにモデルの規模と学習データの量を大幅に拡大することで、その能力を大幅に向上させています。

GPT-3の作文能力を示す事例に、GPT-3に大学の各科目のレポートを書かせ、学生のレポートに混ぜて採点してもらった実験があります。実験の結果、GPT-3が落第点だったのはわずか1科目であり、全体的には学生とほぼ同様の評価が得られたとのことです。

BERTとGPT-3の違い

では、GPT-3とBERTの違う点は何なのでしょうか? 主な違いは(1)得意分野、(2)チューニング方法、(3)利用形態――の3つです。

まず得意分野ですが、BERTは質問応答(質問に対する回答を文書中から見つけてくる)や文の比較(片方の文がもう一方の文の内容を含んでいるか)といったタスクが得意なのに対して、GPTシリーズは、要約や対話生成などの文章の生成が得意です。これは事前学習の際、GPTシリーズが、マスクされた単語より前のテキストだけを使って単語を予測するのに対し、BERTは、マスクされた単語の前後のテキストを予測に用いることに起因します。

次に、チューニング方法です。前述の通り、BERTは実現したいタスクに応じた数百レベルの学習データを用意してファインチューニングを行います。それに対して、GPT-2やGPT-3はチューニングに数例のデータしか必要としません。このチューニング方法を「few-shot学習」といいます。

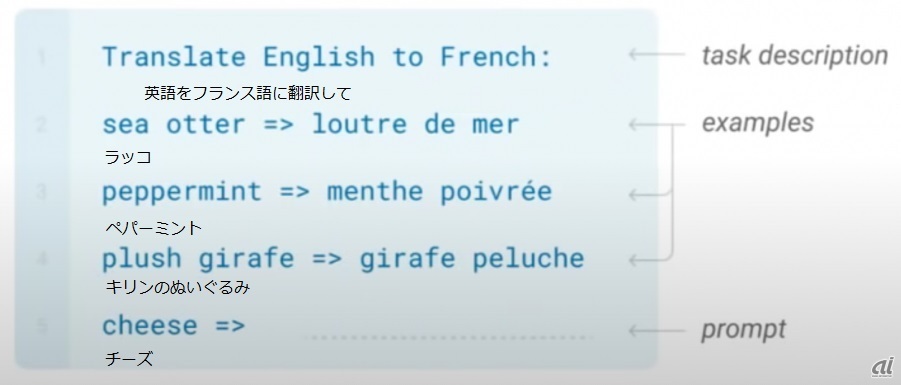

具体的には、まず行いたいタスクの説明(task description)、続いて入力と出力の例(examples)を入力します。これでチューニングは完了です。下の図5は英語からフランス語への翻訳がタスクの例で、いくつかの単語について、英語とフランス語のペアを入力と出力の例として与えたあと、訳してほしい英語の単語(cheese)を、回答を促す入力(prompt)として与えています。すると、この後GPT-3はcheeseのフランス語訳であるfromageを出力するはずです。

図5:few-shot学習の例 タスク:翻訳(英語からフランス語)

図5:few-shot学習の例 タスク:翻訳(英語からフランス語)

※クリックすると拡大画像が見られます

一見、GPT-3はBERTよりチューニングに必要な学習データの量が少なくすむので良いように感じますが、実はそうでもありません。GPT-3はBERTに比べてあまりにも巨大であり、1回の学習に数億円の費用が掛かると言われています。それゆえ、BERTのようなファインチューニングをすることは、技術的には可能でもコスト的に難しいのです。

そのための代替手段となるfew-shot学習は、実は本当に学習を行っているわけではなく、巨大な汎用事前学習モデルの中の学習結果から求められている学習結果を引き出しているだけなのです。そのため事前学習で学習できなかったものは、いくら例を追加しても新たにGPT-3に学習させることはできません。つまり、GPT-3のチューニングは必ずしもうまくいくとは限らないという欠点をもっています。

最後に利用形態ですが、GPT-3はBERTのようにプログラムを公開しておらず、学習済みのモデルも配布されていません。また、日本語向けのモデルも存在しません。英語を中心にした多言語を学習したモデルをOpenAIが提供するクラウドサービスから利用することしかできません。そういった面から日本におけるGPT-3の普及は、まだしばらく先のことと考えられます。

次回は、BERTとGPTシリーズに続く新たな言語理解AIに関する動向について紹介していきます。

(第3回は8月下旬にて掲載予定)

- 城塚 音也(しろつか おとや)

- NTTデータ先端技術

ソフトウェアソリューション事業本部

AIソリューション事業部 AIサービス開発担当

プリンシパルサイエンティスト - 1988年、日本電信電話(NTT)入社。1989年からNTTデータにて音声対話システムやテキストマイニングなどのAI技術の研究開発に従事。AIソリューション推進室長、AIソリューション開発部長を経て2017年4月よりNTTデータ先端技術でAIソリューションの企画、AI導入コンサルを主導。 NTTデータ エグゼクティブR&Dスペシャリスト、SRIインターナショナル インターナショナルフェロー。