人工知能(AI)による画像生成は、創造力を刺激し、コンテンツ制作に革命を起こす可能性を秘めている。しかし悪用された場合、誤った情報の拡散や、名誉の毀損(きそん)によって実質的な被害をもたらす恐れがある。Microsoftは、同社の生成型AIツールに新たな保護機能を実装することでそうした悪用を防ごうとしている。

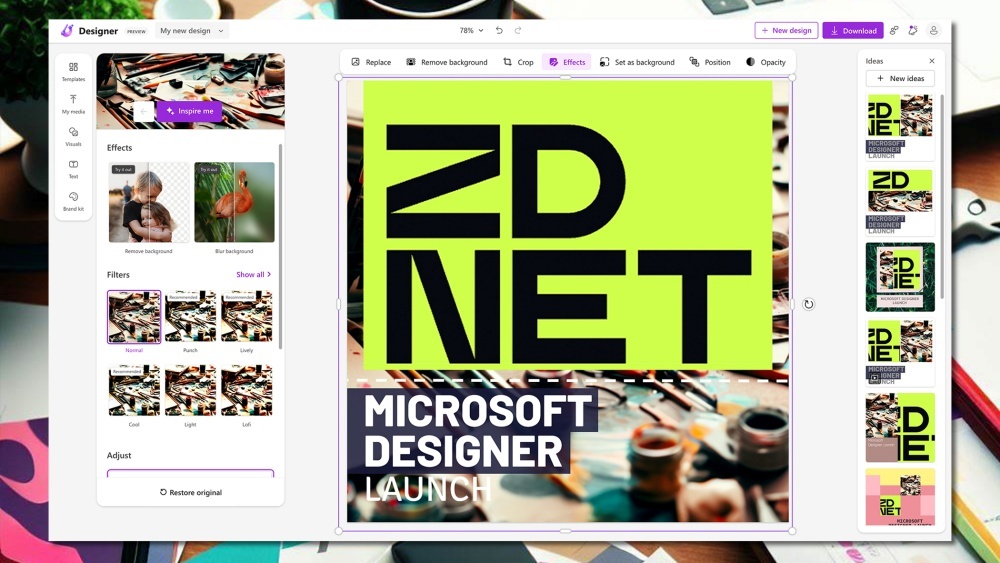

提供:Maria Diaz/ZDNET

AIによって生成されたTaylor Swiftさんのディープフェイクポルノが「X」(旧Twitter)上で拡散されたのは先週のことだ。404 Mediaの報道によると、こうした画像は4chanや、Telegramのチャンネル内で共有されていたものであり、そうした媒体ではユーザーが「Microsoft Designer」などを用いて作り出したセレブのAI生成画像が共有されているという。

Microsoft Designerは、同社のAI画像生成機能である「DALL・E 3」を活用してリアリティーのある画像を生成する「Image Creator」を搭載したグラフィックデザインアプリだ。その画像生成機能には、ヌードや公人に関する不適切なプロンプトを防止するための保護策が以前から搭載されていた。

しかし同報道によると、一部のユーザーはセレブの名前の綴りを変えたり、画像を描写する際に性的な用語を明確に使用しなかったりすることで、同じ結果を得るという抜け穴を発見したという。

Microsoftは既にこうした抜け穴をふさぎ、セレブの画像を生成できないようにしている。筆者は試しに、Image Creatorに対して「Selena Gomezさん(米国の女優/歌手)がゴルフをしているところ」というプロンプトを与えてみた。すると、そのプロンプトをブロックしたという警告が返ってきた。名前の綴りを変えてみても、同じ警告が返ってきた。

Microsoftの広報担当者は米ZDNETに対し、「当社は全ての人々にとって安全で、他者を尊重したかたちでのエクスペリエンスを提供することを約束する」と述べ、「これら画像についての調査を継続しており、今後はそういった画像の生成に向けて当社のサービスが悪用されないよう、既存の安全システムを強化している」とした。

さらに、同社はアダルトコンテンツや同意のない性的コンテンツの生成を明確に禁止しているため、このポリシーに違反した際には同サービスの利用が一切禁じられる可能性もある。

404 Mediaの報道によると、Telegramのチャンネルでは、こうした新たな保護機能を回避する方法について興味を示しているユーザーも既に出てきているという。つまり、一連の動きは、生成型AIを利用したツールの抜け穴を探し、悪用しようとする悪意あるユーザーと、そうした抜け穴をふさごうとするサービス提供企業との間で果てしなく繰り広げられるいたちごっこになる可能性が高いだろう。

この記事は海外Red Ventures発の記事を朝日インタラクティブが日本向けに編集したものです。