グローバルでは多くのメーカーと協業するネットアップだが、今回の勉強会では国内企業に限定して取り組みを紹介した。

GPUメーカーのエヌビディア(以下、NVIDIA)とは、AIスーパーコンピューターをサブスクリプションで利用できる「NVIDIA DGX SuperPOD」の開発に協力。「ストレージの提供にとどまらず、KubernetesでBeeGFS(HPC用パラレルファイルシステム)を使うためのドライバー開発など」(大野氏)も担った。

また、富士通とNVIDIAとは2018年から結んできた協業を強化して、「FUJITSU AI Zinraiディープラーニングシステム」にネットアップのAI/機械学習ソリューション「NetApp AI Control Plane」、NVIDIAの「NVIDIA A100 TensorコアGPU」などを組み合わせたMLOpsソリューションを提供中だ。

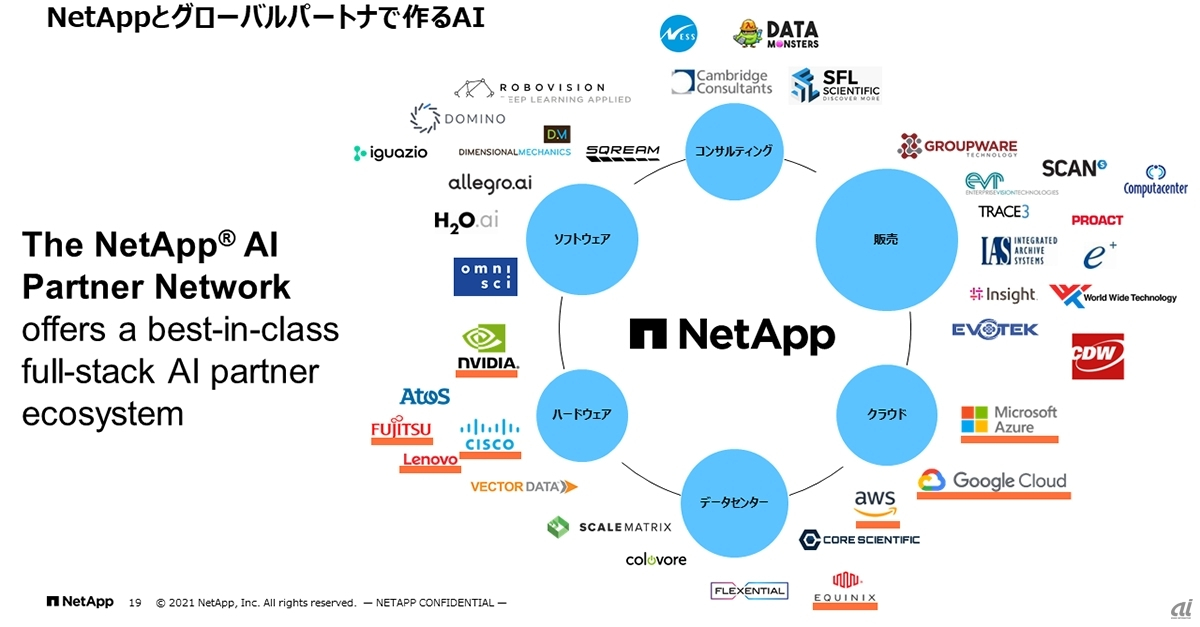

ネットアップと協業する各企業

ネットアップと協業する各企業

※クリックすると拡大画像が見られます