(編集部注:TechRepublicの記事を前編と後編の2回に分けて翻訳して公開します。前編は1月24日に公開されています)

人型ロボットが従うべき規則

ロボットに殺人を許すかどうかという議論は、特に殺人ロボットが存在しない現状において、少し難解かつ曖昧なものに感じられるかもしれない。ロボット(と人工知能)の社会に占める役割がかつてないほど大きくなっているため、われわれは、どこまでが許され、どこからが許されないのかという境界線を見出そうとしているところなのである。

われわれが今までに行ってきているのは、米国防総省(DoD)の自律型兵器システムに関するポリシーに代表されるような、特定の状況における規則を決定するということだ。また、ロボット兵器ほどのインパクトのある話ではないが、米国の一部の州では最近、自動運転技術を搭載した自動車の公道走行を許す法律が制定されるようになってきている。こういった特定状況下における自律型ロボットの規則が少しずつ作成されるようになってきているものの、より大きな観点に立って議論されることはほとんどない。

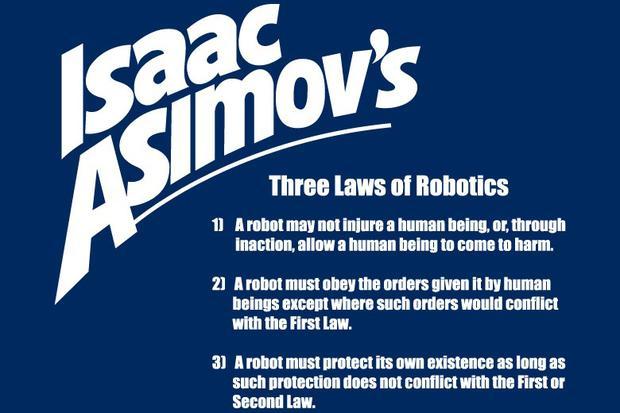

しかし、AIやロボットを支配する一連の規則、すなわち道徳的な枠組みを定めようとする試みもある。ロボットに対して作成された規則で、現在と過去を通じて最も有名なものは、アイザック・アシモフによって1942年に初めて定義された(もっともこれはフィクションの世界の話であるが)、ロボットの振る舞うべき道徳的枠組みを記した「ロボット工学三原則」である。

アシモフのロボット工学三原則とは以下のようなものだ。

- ロボットは人間に危害を及ぼしてはならず、また人間に危害が及ぶのを見過ごしてはならない。

- ロボットは人間によって与えられた命令に従わなければならないが、そういった命令が第1の原則に抵触する場合はその限りではない。

- ロボットは第1の原則や第2の原則に抵触する場合を除き、自らの存在を保護しなければならない。

アシモフのロボット工学三原則

提供:raidz3ro.com

ロボット工学やAIはこういった原則やその他の洗練された規則を理解したり、順守できるだけの能力を持ったロボットを構築できるレベルにまだ達していない。そしてロボット掃除機は、この種の道徳的複雑さを備えている必要などない。