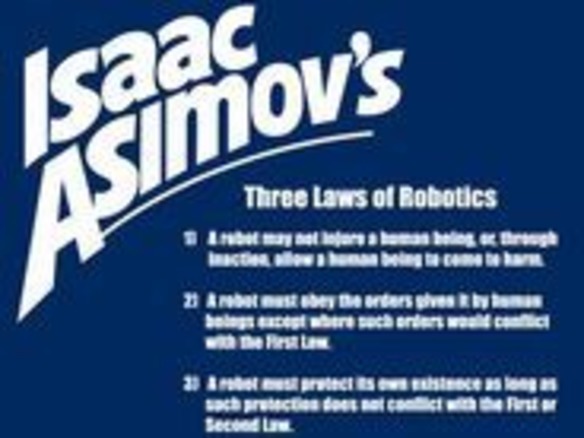

バース大学のJoanna Bryson博士は「人々はアシモフの原則を思い描きがちであるが、これはそもそも単純な倫理システムでは思い通りの結果が得られないという事実を指摘するために作り出されたものだ。アシモフの短編集を読むと、いずれの作品でもこの原則に起因する問題が発生している。つまりこのような原則は、まったく実用的ではないのである」と述べている。

Bryson博士はロボットやAIを最新型の道具一式として捉えるべきだと主張している。つまり、極めて洗練されてはいるが、それ以上のものではないというのである。同博士は、書くという行為によって人間は頭の中にある記憶を書籍などに移せるのと同様に、AIは人間の知性を拡張する道具でしかないと述べているわけだ。同博士は「われわれは人工知能のようなものを使って数千年にわたって世界を変革し続けてきている」と述べるとともに「われわれはこれをより迅速に行うようになってきているだけなのだ」と述べている。

Bryson博士にとっては、人型ロボットが自律動作できようが、知性を持っていようが関係ない。こういったものは道具でしかないため、規則を必要とするのはロボットでなく、われわれの方なのだ。同博士は「人型ロボットはわれわれの道徳的枠組みの中に位置付けておかなければならない。人型ロボットが自らの内部に道徳的枠組みを持つことなどない。ロボットがこの惑星上のその他すべての存在に被害を与えないよう、われわれは自らの道徳的枠組みの中でロボットの位置付けを定義するような意思決定を行わなければならない」と述べている。

英国の工学物理科学研究会議(EPSRC)も、ロボット向けの現実的な規則を作り出そうとした数少ない組織の1つである。しかしすぐに、現時点で必要なものはロボット向けの規則ではないという結論に達した。

その「Principles of Robotics」(ロボット工学の原則)には「アシモフの原則は、ロボットを人間視し、何らかの方法でその振る舞いを規制しようとするものであるため、不適切であると言える。現実世界において、何らかの法則が必要なのはロボットを設計し、使用する人間なのだ。われわれの社会にロボットを迎え入れることに関する倫理的な側面に目を向けると、責任の所在がロボット自体にないのは明らかだ」と記されている。

これらの点から、Bryson博士をはじめとするEPSRCの専門家たちが描き出した一連の原則は、設計者や製造者、ロボットのユーザーに向けたものとなっており、ロボット自体に向けたものとはなっていない。

例を挙げると、この5つの原則には「ロボットではなく人間が責任あるエージェントとなる。ロボットは既存の原則に準拠し、プライバシーを含む基本的な権利と自由を守るための実用性を確保するという制約のなかで設計および運用されるべきである」という項目が含まれている。